全文总字数:1907,阅读大约需要 5 分钟。

前段时间的必(mō)刷(yú)新闻,刷新了我的世界观……

包头警方发布一起利用AI实施电信诈骗的典型案例,福州市某科技公司法人代表郭先生10分钟内被骗430万元。

What???!!

10分钟430万???

AI诈骗???

10分钟赚了我这辈子都赚不到的钱……

果然

新闻上的AI:10分钟诈骗430万!!!!!!

事情是这样的:

郭先生好友突然通过微信视频联系他,声称自己的朋友在外地竞标,需要430万保证金,且需要公对公账户过账,想要借郭先生公司的账户走账。

基于对好友的信任,加上已经视频聊天核实了身份,郭先生没有核实钱款是否到账,分两笔把430万转到了好友朋友的银行卡上。

郭先生拨打好友电话,才知道被骗。

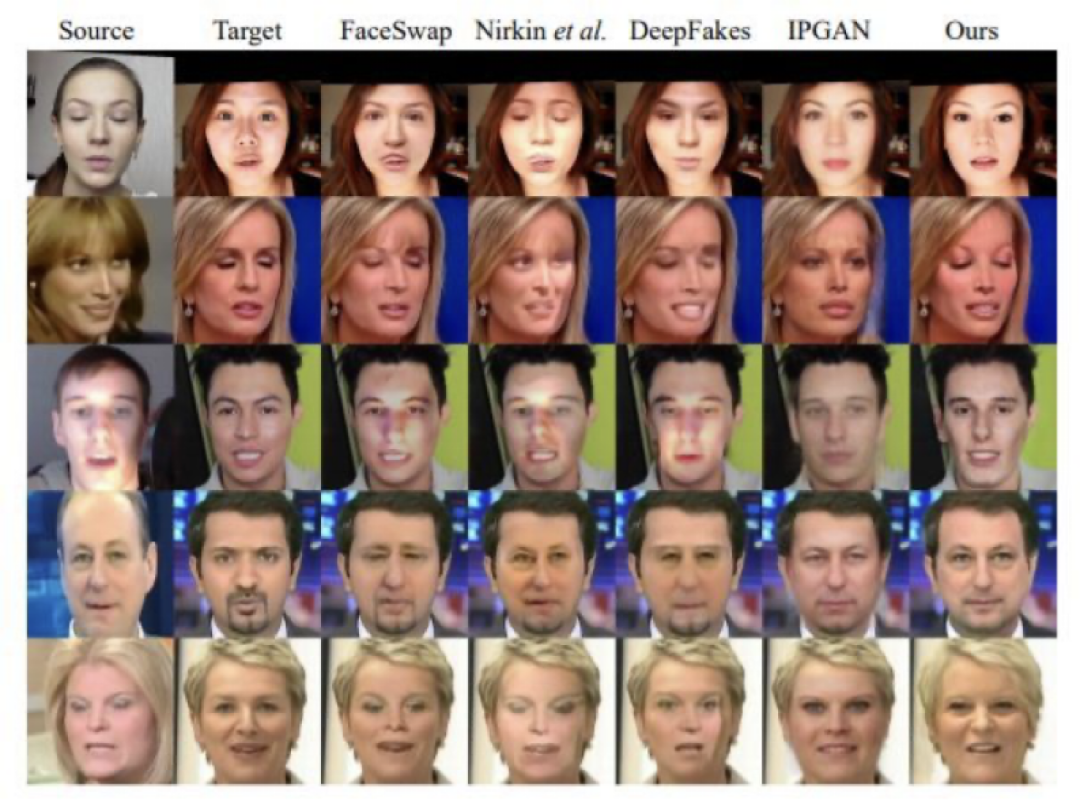

骗子通过智能AI换脸和拟声技术,佯装好友对他实施了诈骗。

AI绘画和ChatGPT来势汹汹的大潮流下,AI被不法分子用于诈骗,终究还是出现了……

诈骗大致分为两种,一种是通过电话/微信语音进行诈骗;

另一种是合成视频,通过视频电话的方式进行诈骗。

以上的两种均防不胜防。尤其是在特定的场景下,导致人的心理防线很容易被击溃,变得完全相信对面是真实的。

就像上面说到的郭先生,作为一名科技公司的法人都无法幸免,何况我们普通人。

那么普通人有什么办法可以防止AI诈骗呢?

接下来:

知己知彼,方能百战百胜!

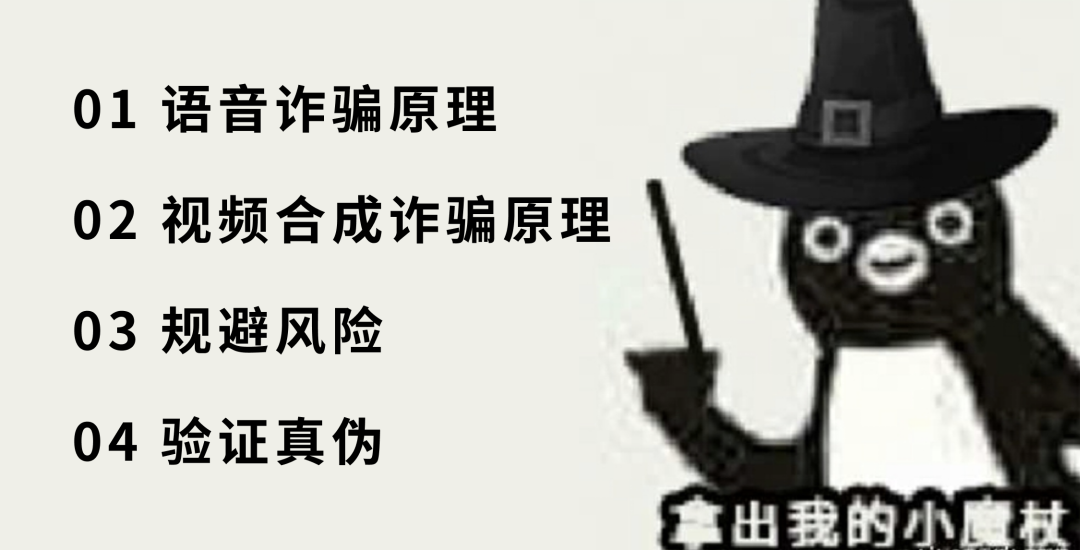

语音诈骗原理

语音诈骗原理首先我们要知道诈骗犯运用AI实施犯罪的操作原理。

1.不法分子通过网络或其他非法途径获取用户的信息,将用户信息进行整合,分析用户画像。

当不法分子对用户的消息了解越多,则越容易实行诈骗。

一般而言,通过给用户打骚扰电话,获取用户的声音样本。

(社恐深i+电话恐惧症成功躲避了一万个诈骗电话)

然后将声音样本放进AI中,通过Deepfake技术,就可以转化成任何想说的话。

通常首选目标是家人、其次是朋友最后是同事。

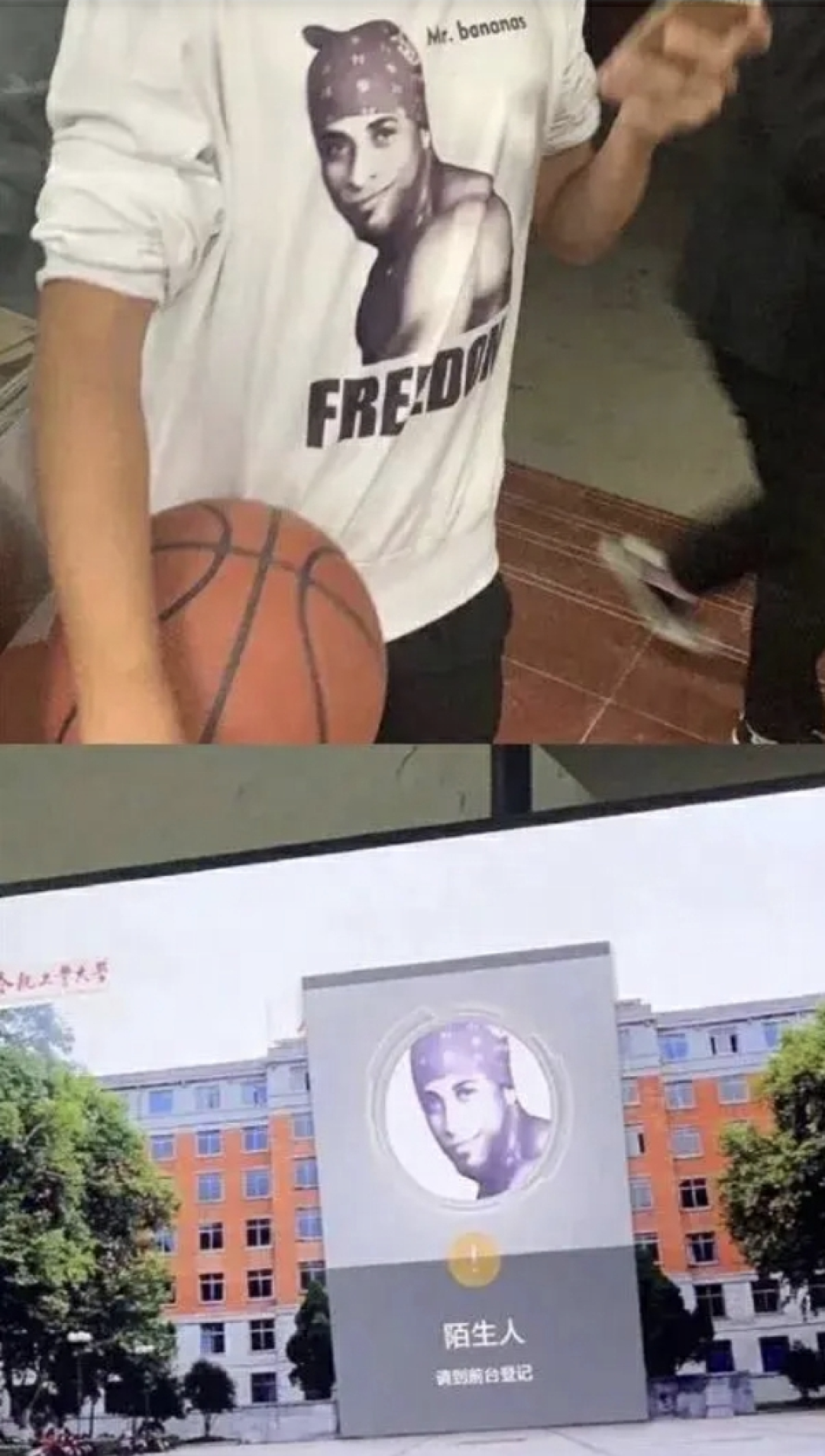

2.获取用户的照片,主要是用户发布到网上的。或是通过App授权相册权限,拿到手机照片。

3.通过换脸,将用户的脸换到不法分子脸上,然后通过软件和用户的家人亲戚、朋友、同事进行视频对话,实施诈骗。

非法App,会窃取手机中的相册、通讯录,获取用户的所有联系方式。然后对通讯录里联系人进行诈骗。不明App甚至会让手机中毒。

相信很多人都接过这样的电话:

“喂,您好 这里是京东客服…

“喂,请问是xxx先生/小姐吗?这里是公安局,怀疑你和xx案件有关…

“喂,您好这边是xx市(当地)xx局(税务/社保/金融等等…

这样前缀开头的请不要怀疑!

不放心的话,则直接去官方App,找到客服询问验证。

不法分子伪装淘宝客服,那么就去淘宝App,找到官方客服,咨询。

招行客服打电话,则去招行App找官方客服。

各种短视频平台很多人展示自己和诈骗犯子电话斗智斗勇的过程,顺着话茬,让他们无地自容(十分不推荐,不建议大家为了乐子去以身涉险,一切以保证自身信息安全为原则!!)

还真的有大冤种为了找乐子搭进去好几万的……

如果诈骗分子获取其他人的语音,通过合成语音诈骗。

我们和对方通电话时,可以尝试问一些彼此才知道的事情以此来判断。

可以不断地更新暗号,这样能减少上当受骗。

4.视频诈骗

现有AI技术,在进行视频时,如果感觉到对方的脸部不够自然,可以让对方用手摸一下脸,由于AI需要运算时间,在摸脸的一瞬间,会出现画面闪烁,变形的情况。

温馨提醒:警惕各种AI换脸产品,任何AI娱乐的前提都是保护好个人隐私。

害人之心不可有,防人之心不可无,防我之心万万不可~(求三连

这么好的防诈骗科普文章,还不快转发给家族群,谨防被诈骗!!

这么好的防诈骗科普文章,还不快转发给家族群,谨防被诈骗!!

⬇️点击阅读原文,加入大厂AIGC实战俱乐部

本篇文章来源于微信公众号: ASAK